Stellen Sie sich vor, Sie sitzen in einem Zoom-Call und Ihr Vorgesetzter bittet Sie – von Angesicht zu Angesicht – eine Überweisung zu tätigen. Würden Sie vorher nachprüfen, ob die Person auf dem Bildschirm wirklich echt ist? In Zeiten von Deepfakes, also Bildern oder Videos, die per KI täuschend echt reale Personen nachahmen, sollten Sie dies besser tun. Erfahren Sie mehr über diese faszinierende Technologie, die viele Chancen, aber eben auch ganz neue Gefahren mit sich bringt.

Ist echt, was ich sehe?

Mithilfe von Deep Learning (einer Form des Maschinellen Lernens) lassen sich Fotos, Videos und Audioaufnahmen so verändern, dass ein Gesicht, ein Körper oder eine Stimme in einem völlig anderem Zusammenhang auftaucht und es so wirkt, als würde die Person Dinge sagen oder tun, die sie in Wahrheit nie gesagt oder getan hat. Das Ergebnis: Ein sogenannter Deepfake.

Schon gewusst? Schon 10-20 Sekunden einer Audioaufnahme der Stimme eines Menschen können ausreichen, um einen Audio-Deepfake zu erstellen.

Die Technologie dahinter hat in den letzten Monaten sehr viel Aufmerksamkeit erhalten – spätestens, seitdem sie für jedermann frei verfügbar ist. Apps wie FaceApp machen es möglich, Deepfake-Videos von quasi jeder Person auf der Welt zu erstellen. So kann man zum Beispiel sein eigenes Gesicht in ein bekanntes Musikvideo einbauen oder zur Hauptfigur in der persönlichen Lieblings-Filmszene werden. Doch Deepfakes machen nicht nur Spaß. In den falschen Händen können per KI erstellte Video- oder Audioaufnahmen zu hochwirksamen Tools für die Cyberkriminalität werden und dazu dienen, Einzelpersonen oder Unternehmen massiv zu schaden.

Rache, (Wahl-)Betrug und Cyberangriffe: Deepfakes als Waffe

Deepfakes sind also bei Weitem nicht nur witzig und unterhaltsam. Die Verbreitung der Technologie kann weitreichende rechtliche, persönliche und politische Folgen haben. Zudem hilft sie Cyberkriminellen, noch wirksamere Social Engineering-Methoden zu entwickeln.

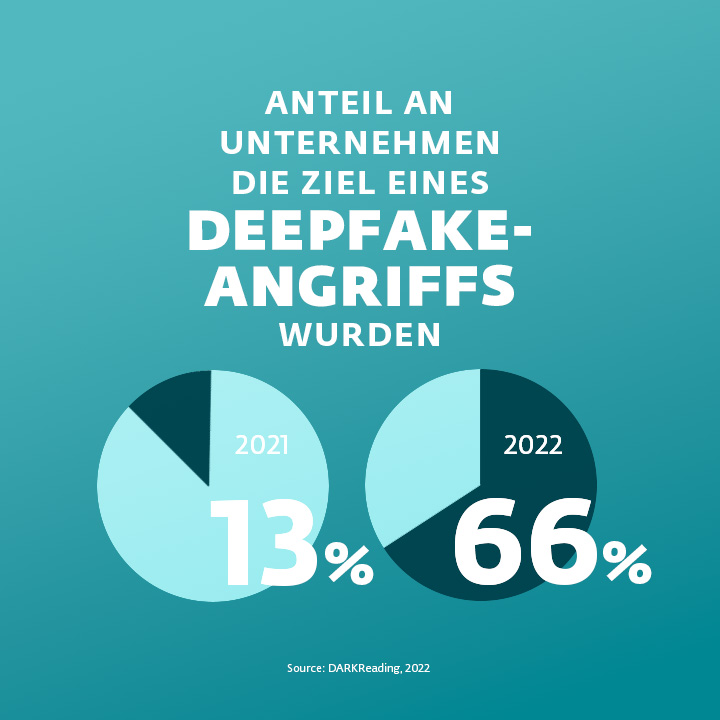

Quelle: DARKReading, 2022

Bei der Cyberkriminalität werden Deepfakes genutzt, um die Opfer zu erpressen, zu betrügen und zu Dingen zu verleiten, die sie gar nicht tun wollen. So kann beispielsweise versucht werden, leitende Angestellte mit Fake-Videos zu erpressen. Entweder sie zahlen ein Lösegeld oder die kompromittierenden Inhalte des Videos bringen das komplette Unternehmen in Misskredit. Noch häufiger sind allerdings sogenannte „Vishing“-Angriffe, bei denen mithilfe von Audio-Deepfakes versucht wird, Mitarbeiter zu Aktivitäten zu verleiten, die dem Unternehmen schaden – vermeintlich auf Anweisung der Unternehmensführung.

Einer der bisher bekanntesten Deepfake-Angriffe war der vermeintliche Anruf eines Vorgesetzten, den der CEO eines britisches Energieunternehmens 2019 erhielt. Er wurde angewiesen, fast eine Viertelmillion Pfund an einen Zulieferer in Ungarn zu überweisen. Weil die Stimme des Anrufers der seines deutschen Chefs sehr ähnlich war, befolgte der CEO die Anweisung. Bald darauf folgten jedoch ein weiterer Anruf und die Order, noch mehr Geld zu überweisen. Der Angerufene wurde misstrauisch und schaltete die Behörden ein. Kurz darauf stellte sich heraus, dass das Opfer auf Vishing hereingefallen war – vermutlich mit einem Audio-Deepfake seines deutschen Vorgesetzten.

2022 bekam in einem weiteren Fall der Kommunikationschef der Kryptobörse Binance, Patrick Hillmann, mehrere Anrufe von verschiedenen Personen, die behaupteten, mit ihm Kontakt gehabt zu haben. Den Anrufern zufolge hätten sie darüber gesprochen, dass sie Vermögen in Form von Binance-Tokens auf der Plattform würden handeln können. Hillmann war zunächst überrascht, kannte er doch keinen der Anrufer und hatte seines Wissens nie Kontakt mit ihnen gehabt. Bald wurde ihm jedoch klar, dass Cyberkriminelle wohl öffentliche Interviews mit ihm genutzt hatten, um eine Deepfake-Kopie von ihm zu erstellen und für Zoom-Calls zu missbrauchen. Während in diesem Fall wohl vor allem diejenigen geschädigt wurden, die Geld an die Angreifer überwiesen hatten, hätte der Vorfall auch dem Ansehen des Unternehmens massiv schaden können.

Keine Chance für Deepfakes

Vor allem besonders gut gemachte Deepfakes können ein mulmiges Gefühl hinterlassen. Es scheint, als ließe sich nicht mehr ohne weiteres erkennen, ob das, was wir online sehen, echt ist oder nicht. Eine gewisse Grundskepsis hilft hier jedoch ungemein. Zweifeln Sie nur ein kleines bisschen an dem, was Sie online sehen, ist das schon ein wichtiger Schritt hin zu mehr Sicherheit im Netz.

Woran genau erkennt man aber nun einen Deepfake? Manipulierte Tonaufnahmen sind generell schwieriger als solche zu erkennen, da sie mehr oder weniger genau wie eine menschliche Stimme klingen können. Nichtsdestotrotz gibt es inzwischen Programme, mit denen sich Audio-Deepfakes identifizieren lassen. Wie funktioniert das? Die menschliche Stimme kann nur eine begrenzte Anzahl Töne erzeugen. Für die „Stimme“ eines Computers gilt diese Einschränkung nicht, sodass sie eben doch ganz leicht anders klingt als die Stimme einer echten Person.

Aber lassen sich Deepfakes auch ohne spezielle Software erkennen? Auch wenn es schwierig sein kann – unmöglich ist es nicht. Folgende Fragen sollten Sie sich stellen, um zu entscheiden, ob es sich bei einem Video oder einer Audiodatei um eine echte Aufnahme handelt:

- Wie glaubwürdig ist der Inhalt? Geht es um besonders empörende Inhalte, die deutlich eine emotionale Reaktion beim Publikum auslösen soll? Wenn ja, könnte das ein erster Anhaltspunkt sein, skeptisch zu werden und das Gehörte/Gesehene genauer zu prüfen.

- Gibt es Details, die seltsam oder verdächtig wirken? Für Deepfake-Autoren ist es oft schwierig, subtilere Mimik und Gestik abzubilden, z.B. Blinzeln, Atembewegungen oder kleinste Bewegungen von Gesicht oder Haaren. Teilweise lassen sich auch minimale Fehler in den Bildabschnitten entdecken, in denen die meiste Bewegung stattfindet. Bei Audioaufnahmen achten Sie vor allem auf unnatürliche Pausen zwischen Wörtern oder eine allzu perfekte Aussprache und geschliffene Formulierungen.

- Bewegt sich die Person natürlich? Spricht jemand, neigen wir dazu, eher auf das Gesicht als auf den Rest des Körpers zu achten. Deepfake-Autoren konzentrieren sich daher auf die Imitation von Mimik, weniger die Form oder Bewegungen des Körpers der Person. Erscheint Ihnen hier etwas seltsam, haben Sie es vielleicht mit einem Deepfake zu tun.

- Passt der Ton zum Video? Manchmal gelingt es Deepfake-Autoren nicht, den Ton perfekt an die Bewegungen der Person anzupassen. Hier gilt es also wieder, das Gesicht der sprechenden Person genau zu beobachten. Passen die Mundbewegungen wirklich zu dem, was angeblich gesagt wird?

- Passt die Beleuchtung? Oder erscheint der Kopf der Person auffällig hell oder dunkel? Abweichungen der Beleuchtung von dem, was zu erwarten wäre, deuten auf einen Deepfake hin.

Security Awareness – aber unterhaltsam

IT-Teams sind dafür verantwortlich, die Mitarbeiter des Unternehmens über Deepfakes und die damit verbundenen Risiken aufzuklären. Gerade bei einer Technologie, die ebenso gefährlich wie spannend sein kann und sowohl für kriminelle als auch unterhaltende Zwecke genutzt werden kann, sollte die Mitarbeiterschulung auf Spaß und Interaktion setzen.

Schicken Sie Ihren Kollegen zum Beispiel verschiedene Videos und lassen Sie sie entscheiden, welche echt und welche gefälscht sind. Fördern Sie die Interaktion der Lernenden, helfen Sie Ihren Kollegen, sich an das Gelernte besser zu erinnern und dieses Wissen einzusetzen, um die Cybersecurity im Unternehmen aktiv zu verbessern.