En mars 2021, le FBI a prévenu que les deepfakes pourraient être la prochaine grande cybermenace. Quelles en sont les raisons ? Selon l’agence fédérale américaine chargée de l’application de la loi, ces menaces pourraient comporter des simulations sophistiquées de n’importe quel employé d’une entreprise. Quelles sont les conséquences pour les petites entreprises ?

Les deepfakes ne jouent pas encore un rôle suffisamment important dans les scénarios d’ingénierie sociale. Pourtant, le Forum économique mondial a commencé à s’intéresser à cette technologie, en précisant qu’elle pourrait potentiellement nuire aux entreprises. Elle devient en effet de plus en plus sophistiquée et son application de plus en plus répandue. De nombreux autres experts partagent ce point de vue. Selon un rapport de CyberCube, les deepfakes pourraient devenir une menace majeure pour les entreprises au cours des deux ou trois prochaines années.

Les deepfakes sont de plus en plus faciles à réaliser, nécessitant moins d’images sources pour les développer, et peuvent même être commercialisés. Afin de mieux comprendre l’utilisation possible de cette technologie en matière d’ingénierie sociale, passons à la pratique. Comment les deepfakes peuvent-ils présenter un risque ?

1) Une forme très convaincante d’usurpation d’identité

L’un des premiers cas s’est produit il y a deux ans. En août 2019, des cybercriminels ont trompé une entreprise, lui faisant effectuer un virement bancaire de 243 000 dollars à l'aide d’une imitation de la voix du PDG, en ayant recours à l’IA. Plus tard, la victime a déclaré que l’appelant avait reproduit de manière convaincante le ton et l’accent allemand de son employeur. Le cybercriminel n’a pas eu à faire d’efforts ici pour réaliser une vidéo. Il lui a simplement suffi de passer un appel téléphonique.

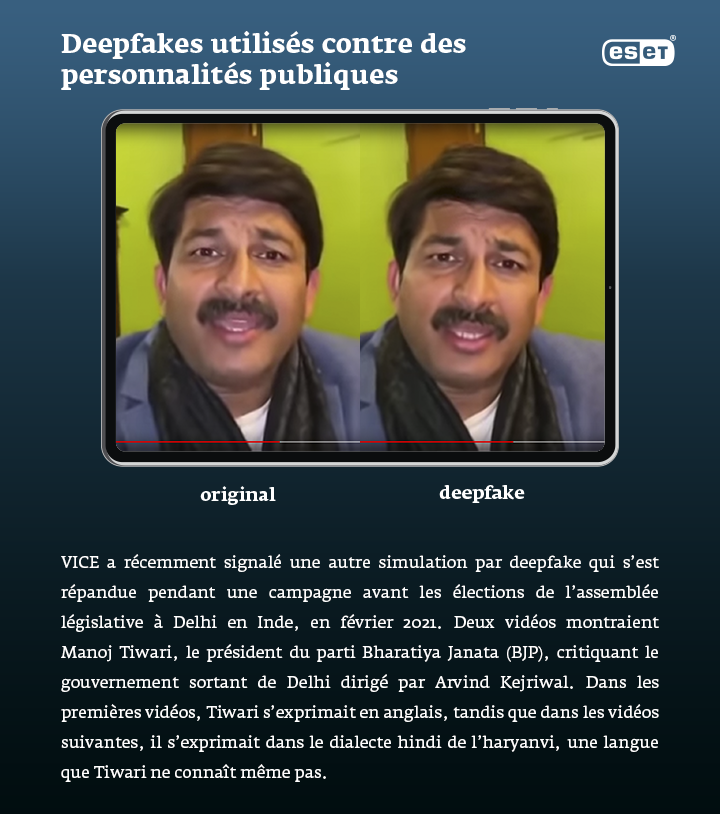

Si de nombreuses vidéos populaires de deepfakes comportent le remplacement complet du visage, une autre possibilité consiste à créer un deepfake à partir d’une vidéo existante. Avec un algorithme employant la synchronisation de la parole, vous pouvez utiliser l’enregistrement audio d’une personne réelle afin de former l’algorithme à retranscrire les sons en mouvements de lèvres. Cette technologie pourrait potentiellement être utilisée pour mettre des paroles dans la bouche de PDG, de fournisseurs importants ou de tout employé pour simplement demander à ses collègues de transférer de l’argent ou de communiquer des identifiants. D’ici là, ces attaques viseront probablement des cadres dirigeants pour porter atteinte à la réputation d’une entreprise.

Vous voulez en savoir plus sur ce type d’attaque ? Lisez notre article Usurpation d’identité : quand un cybercriminel se fait passer pour un PDG.

2) La sextorsion dans ce qu’elle a de pire

Comme l’a récemment déclaré VICE, depuis que les deepfakes ont explosé en 2017, la technologie a été largement utilisée pour créer de faux contenus pour adultes en utilisant des séquences vidéo de célébrités existantes et des algorithmes d’IA. Mais dans plusieurs cas, des personnes ordinaires (principalement des femmes) ont été insérées dans ces fausses vidéos et ont ensuite été victimes de chantage. Elles n’ont même pas eu à faire quoi que ce soit de mal. Tant que la véritable origine de la vidéo n’est pas révélée, le contenu peut causer de graves préjudices et nuire à la réputation.

Il est cependant inutile d’effrayer votre personnel avec ces exemples. Expliquez-leur plutôt pourquoi il est important de faire attention aux informations qu’ils partagent en ligne, aujourd’hui plus que jamais. La crédibilité des fausses vidéos dépend actuellement du nombre de photos et de vidéos utilisées par le logiciel pour créer une simulation. Ainsi, quiconque peut commencer à se protéger en faisant attention à son empreinte numérique et au nombre de photos partagées en ligne.

3) Nouveaux scénarios impossibles à démentir

Selon Cyberscout, l’un des facteurs limitant la propagation des deepfakes est simple : les escrocs n’en ont pas encore véritablement besoin. Pour le moment, les types existants d’attaques d’ingénierie sociale fonctionnent bien pour les pirates, ce qui peut également être interprété comme des lacunes dans la formation à la cybersécurité dans les entreprises. Mais lorsqu’on en sera arrivé au point où le personnel de la majorité des entreprises sera formé régulièrement et que la cybersécurité multicouche deviendra la norme, le moyen le plus efficace d’attirer l’attention des gens et de les forcer à faire quelque chose consistera à se faire passer pour quelqu’un de confiance en leur faisant croire qu’ils agissent de la bonne façon.

Comment ne pas tomber dans le piège d’un deepfake ?

Pour se protéger, vous et votre entreprise, des effets de ces fraudes, il est bon de savoir dans quelles situations ces attaques peuvent se produire. Le FBI indique qu’il faut s’attendre à de nouveaux scénarios de ce type dans des situations telles que les réunions à distance. Ainsi, il convient de prendre des mesures pour former les collaborateurs, en leur enseignant des techniques de vérification efficaces et en reconnaissant les erreurs qui peuvent être repérées dans les photos ou les vidéos truquées. Même si le FBI et les experts en informatique estiment que les obstacles auxquels se heurtent les criminels soucieux de créer des escroqueries convaincantes vont inévitablement diminuer. Ce type de formation peut au moins aider les utilisateurs à mieux comprendre le contexte dans lequel les deepfakes apparaissent et ce qu’ils peuvent faire.

Des outils tels que la plateforme de vérification de Sensity.AI ou le plug-in pour navigateur Reality Defender permettant de détecter les fausses vidéos, peuvent être utilisés pour identifier les deepfakes. Vous pouvez également mettre en place plusieurs mesures de sécurité pour empêcher la manipulation de vos contenus ou de vos données sensibles, notamment l’ajout de pixels parasites à vos vidéos pour repérer les modifications, ou l’analyse des images ou du spectre acoustique afin de détecter toute distorsion dans les vidéos truquées.

Les deepfakes commencent lentement à mettre à l’épreuve la résilience humaine. Il est donc temps de renforcer votre système informatique.