Los clones de voz creados con inteligencia artificial pueden ponérselo demasiado fácil a los ciberatacantes. Jake Moore, Global Security Advisor de ESET, lo ha vivido en primera persona.

Los clones de voz creados con inteligencia artificial pueden ponérselo demasiado fácil a los ciberatacantes. Jake Moore, Global Security Advisor de ESET, lo ha vivido en primera persona.

«La calidad de la voz clonada, creada por uno de mis colegas, me sorprendió tanto que decidí utilizar el mismo software con fines 'dudosos' y probar hasta dónde podía llegar y si podía estafar a una pequeña empresa, por supuesto con permiso», afirma Jake Moore, de la oficina británica de ESET.

Spoiler alert: la ejecución fue sorprendentemente fácil y no llevó casi nada de tiempo.

Desde que el concepto de inteligencia artificial se hizo popular gracias a películas como Blade Runner y Terminator, la gente ha sentido curiosidad por el potencial de lo que esta tecnología podría crear en el futuro.

Sin embargo, sólo ahora, gracias a una tecnología informática más potente y a la atención de los medios de comunicación, estamos siendo testigos de cómo la IA alcanza una audiencia global y, gracias a ella, es probable que empecemos a ver ataques creativos y bastante sofisticados con consecuencias muy dañinas.

Usar un clon de voz para pedir dinero

Usar un clon de voz para pedir dinero Jake Moore pasó muchos años trabajando para la policía, lo que le enseñó a pensar como un delincuente. Este enfoque tiene varias ventajas tangibles e infravaloradas: cuanto más piense uno o incluso actúe como un delincuente (sin llegar a serlo), mejor podrá protegerse. Esto es esencial para estar al día de las últimas amenazas y anticiparse a las tendencias futuras.

Para probar algunas de las posibilidades de la inteligencia artificial actual, Jake tuvo que sumergirse una vez más en la mentalidad de un delincuente digital y atacar éticamente a una empresa.

En primer lugar, preguntó a su conocido -llamémosle Harry- si podía clonar su voz y utilizarla para atacar a su empresa. Harry accedió y permitió a Jake iniciar el experimento creando un clon de su voz utilizando un software de fácil acceso. Conseguir la voz de Harry fue bastante fácil: suele crear vídeos promocionales cortos para su empresa en su canal de YouTube. Así que Jake sólo tuvo que combinar algunos de esos vídeos y ya tenía una buena muestra de audio con la que trabajar. En cuestión de minutos, generó un clon de la voz de Harry que sonaba exactamente como él y que podía teclear cualquier cosa que se leyera con su voz.

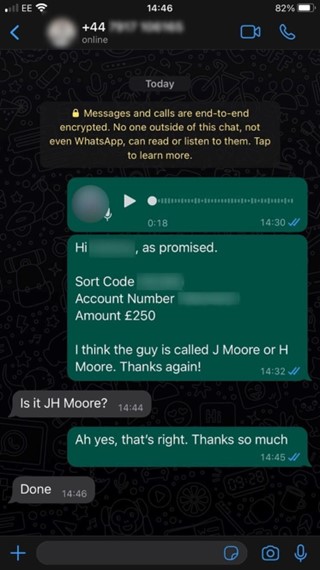

Para que el ataque fuera más convincente, Jake decidió secuestrar también la cuenta de WhatsApp de Harry, con permiso, por supuesto. Intercambiando las tarjetas SIM, Jake consiguió acceder a la cuenta desde la que envió un mensaje de voz a la directora financiera de la empresa, llamémosla Sally. El mensaje contenía una solicitud de pago de 250 libras a un «nuevo proveedor». Jake decidió llevar a cabo el ataque mientras Harry estaba fuera en una comida de negocios, lo que proporcionó el momento perfecto.

En el falso mensaje de voz, Harry indicaba dónde se encontraba y mencionaba que necesitaba pagar a un «nuevo arquitecto», prometiendo enviar los datos bancarios por separado en el siguiente mensaje. La información adicional enviada después del mensaje de voz de WhatsApp bastó para convencer a Sally de que la solicitud era auténtica. A los 16 minutos del primer mensaje, se habían transferido 250 libras a la cuenta personal de Jake.

Jake admite que le sorprendió lo sencillo que era y lo rápido que convenció a Sally de que la voz clonada de Harry era real.

Este nivel de manipulación funcionó gracias a una combinación de factores relacionados:

- El número de teléfono utilizado era el del director

- La historia inventada coincidía con los acontecimientos del día

- El mensaje de voz, por supuesto, sonaba como el jefe

Sally declaró posteriormente que todo lo anterior fue más que suficiente para que accediera a la petición. Ni que decir tiene que, desde entonces, la empresa ha añadido medidas de seguridad adicionales para proteger sus finanzas. Y, por supuesto, Jake devolvió las 250 libras.

Cuenta de WhatsApp de empresa falsa

Robar la cuenta de WhatsApp de otra persona mediante un ataque de intercambio de SIM puede ser un método algo largo para hacer más creíble un ataque, pero ocurre más a menudo de lo que se piensa. Sin embargo, los ciberdelincuentes no tienen por qué ir tan lejos para conseguir el mismo resultado.

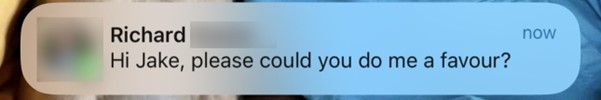

Jake también fue objeto de un ataque que inicialmente parecía creíble. Alguien le envió un mensaje de WhatsApp haciéndose pasar por un amigo que es un alto ejecutivo de una empresa de IT.

La dinámica interesante del ataque fue que, aunque Jake está acostumbrado a verificar la información, este mensaje llegó con un nombre de contacto vinculado en lugar de aparecer como un número. Esto fue especialmente intrigante porque el número del que procedía no estaba guardado en la lista de contactos de Jake, y él supuso que seguiría apareciendo como un número de móvil, no como un nombre.

Al parecer, los atacantes pudieron hacerlo simplemente creando una cuenta de WhatsApp Business, que permite añadir cualquier nombre, foto y dirección de correo electrónico a la cuenta para que parezca auténtica de inmediato. Si a eso le añadimos la clonación de voz mediante inteligencia artificial, voilà, hemos entrado en la nueva generación de ingeniería social.

Afortunadamente, Jake supo desde el principio que se trataba de una estafa, pero mucha gente podría caer en este sencillo truco, que en última instancia podría acarrearle pérdidas económicas.

A medida que el aprendizaje automático y la inteligencia artificial avanzan a pasos agigantados y se hacen cada vez más accesibles a las masas, estamos entrando en una era en la que la tecnología está empezando a ayudar a los delincuentes con más eficacia que nunca, gracias al perfeccionamiento de todas las herramientas existentes que ayudan a ocultar la identidad y el paradero de los delincuentes.

¿Cómo estar a salvo de las estafas de clonación de voz?

Volvamos a nuestros experimentos y repasemos varias precauciones básicas que los propietarios de empresas deben adoptar para no ser víctimas de la clonación de voz u otras estafas.

- Siga los procesos empresariales y de aprobación

- Verifique a las personas y los procesos; por ejemplo, verifique todas las solicitudes de pago con la persona que (supuestamente) presenta la solicitud, incluso dos veces si es necesario, y haga que dos empleados de su empresa aprueben las transferencias.

- Siga las últimas tendencias en el mundo de la tecnología y ajuste en consecuencia la formación de sus empleados y los dispositivos de seguridad.

- Establezca una formación informativa ad hoc para sus empleados.

- Utilice software de seguridad multicapa.

Aquí tienes varios consejos para mantenerte a salvo de los intercambios de tarjetas SIM y otros ataques dirigidos a separarte de tu información personal o de tu dinero:

- Limite la cantidad de información personal que comparte en Internet. Si es posible, evite publicar su dirección o número de teléfono.

- Limite el número de personas que pueden ver sus publicaciones y otros contenidos en las redes sociales.

- Tenga cuidado con las estafas de phishing y otros intentos de sonsacarle información personal.

- Utilice la autenticación de dos factores (2FA), como una aplicación de autenticación o un dispositivo de autenticación de hardware.

- Nunca se insistirá lo suficiente en la importancia de la 2FA: no olvides utilizarla también en tu cuenta de WhatsApp y en todas las demás cuentas que la ofrezcan.

Al ver los ataques de clonación de voz, uno puede asustarse, pero lo cierto es que incluso estas estafas avanzadas pueden esquivarse. Seguir los consejos mencionados y mantenerse alerta puede ayudar a reconocer la voz real de una persona conocida de la de algún robot engañoso.